當我們看到 AI 偶爾給出錯誤、矛盾或甚至是虛假訊息時(我們稱之為「幻覺」),這不只是單純的技術錯誤,其根源就在我們人類自己的知識體系中。

答案就在於:訓練 AI 的人類語料本身就沒有共識。你認為的 AI 錯誤,是某些人腦中的真實。

大型語言模型(LLM)從數以萬億計的網路文本、書籍和論文中學習。這個龐大的數據庫,並非只包含無爭議的「真理」,而是充滿了人類知識的所有面向:科學定論、宗教信仰、民間傳說,以及大量「不見得所有人都認同」的資訊。

舉個例子:當你問「人類會不會有前世記憶?」時,AI 的語料庫中同時存在:科學共識認為意識源於大腦活動、死後消散;也有關於兒童自發性前世記憶的數千個案例研究;更有宗教與哲學觀點堅信輪迴是真實的。

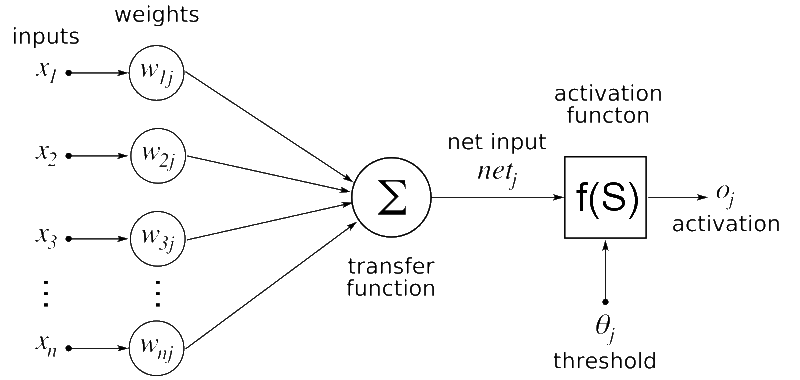

AI 並沒有人類的「信念」或「判斷力」。它會根據這些矛盾的資訊來生成回答,如果某個錯誤或缺乏共識的觀點在語料庫中佔了足夠的份量,AI 就有可能將多種矛盾的資訊「縫合」在一起,產生邏輯不通但語法流暢的內容。

或者更糟的情況:「過度自信」地呈現某個非主流或錯誤的觀點,將其誤認為真理。

AI 的錯誤,不只是技術上的 Bug,更是人類知識不確定性在機器上的投影。它提醒我們,知識並非一個完美的單一體系,而 AI 只是誠實地反映了我們世界中那些尚未解決的歧異與矛盾。

這意味著,與其要求 AI 「不要犯錯」,不如我們自己先搞清楚:在哪些問題上,人類本身就沒有共識?在那些領域,AI 的任何答案都需要你帶著批判性思維去驗證。

圖片來源:Wikimedia Commons,CC BY-SA 授權